Imagine que você está dirigindo e os freios do carro de repente falham. Em uma fração de segundo, você precisa decidir qual o menor dos males a ser causado: atropelar dois idosos e uma criança que estão atravessando a rua ou desviar deles e arriscar matar os dois passageiros adultos que estão com você?

Se para nós humanos é difícil tomar essa decisão, para um carro autônomo a reação a essas situações continua sendo um mistério. E aí reside um dos principais obstáculos ao seu uso nas ruas. Para ajudar a indústria a enfrentar esse problema e apefeiçoar o funcionamento dos veículos que se movem sozinhos, o pesquisador do Massachusetts Institute of Technology (MIT) Iyad Rahwan decidiu investigar o que norteia as decisões humanas e repassar tais critérios às montadoras. Mais de 3 milhões de pessoas já participaram, compondo assim um comportamento moral médio que poderá balizar as decisões que tomadas pelos carros autônomos.

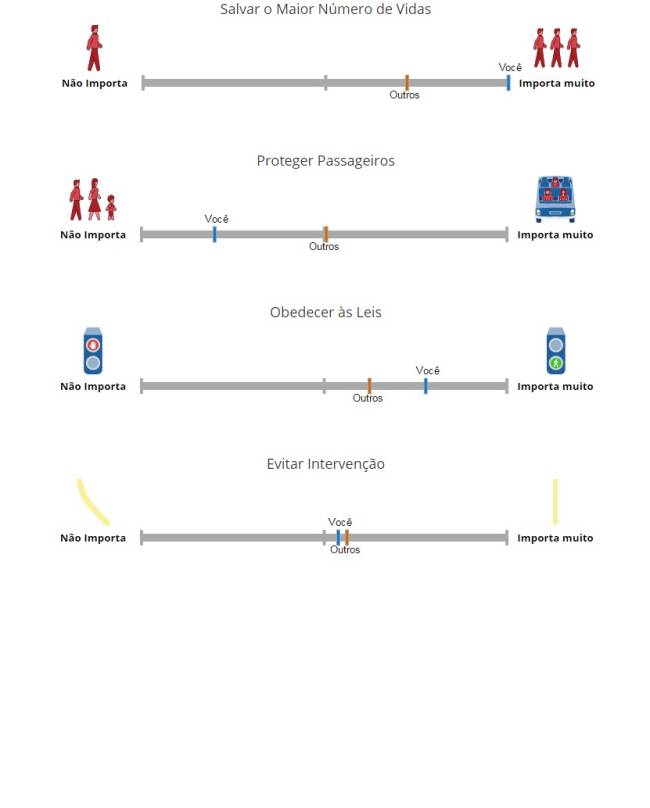

Rahwan criou a Máquina Moral, um site que traz situações em que cabe ao motorista decidir qual mal prefere causar. Entre as possíveis vítimas, há crianças, cachorros, idosos, executivos, pessoas obesas, atletas, moradores de rua, executivos, médicos, gente atravessando a rua no sinal vermelho ou esperando na calçada. Cada elemento é levado em conta para compreender por que o autor decidiu jogar o carro na direção de determinada vítima, e não na de outra. Ao final do questionário, o site mede quais critérios usados nas suas decisões: preservar o maior número de pessoas, preservar animais, poupar quem respeita a sinalização, priorizar quem é mais pobre ou quem tem alguma posição social.

O questionário é uma oportunidade de auto conhecimento, tanto para compreender melhor nossos parâmetros morais quanto de refletir sobre até que ponto nos sentimos confortáveis em delegar decisões tão complexas a uma máquina.

SEGUIR

SEGUIR

SEGUINDO

SEGUINDO

O passado criminoso de um dos maiores campeões da música pop dos anos 80

O passado criminoso de um dos maiores campeões da música pop dos anos 80 As dívidas do homem que explodiu bombas na frente do STF

As dívidas do homem que explodiu bombas na frente do STF Banco rebaixa classificação do Brasil e aumenta aposta na Argentina

Banco rebaixa classificação do Brasil e aumenta aposta na Argentina A Geração Z está trocando o Spotify por uma tecnologia retrô

A Geração Z está trocando o Spotify por uma tecnologia retrô A data mais esperada pelos fãs de novelas entediados com ‘Mania de Você’

A data mais esperada pelos fãs de novelas entediados com ‘Mania de Você’